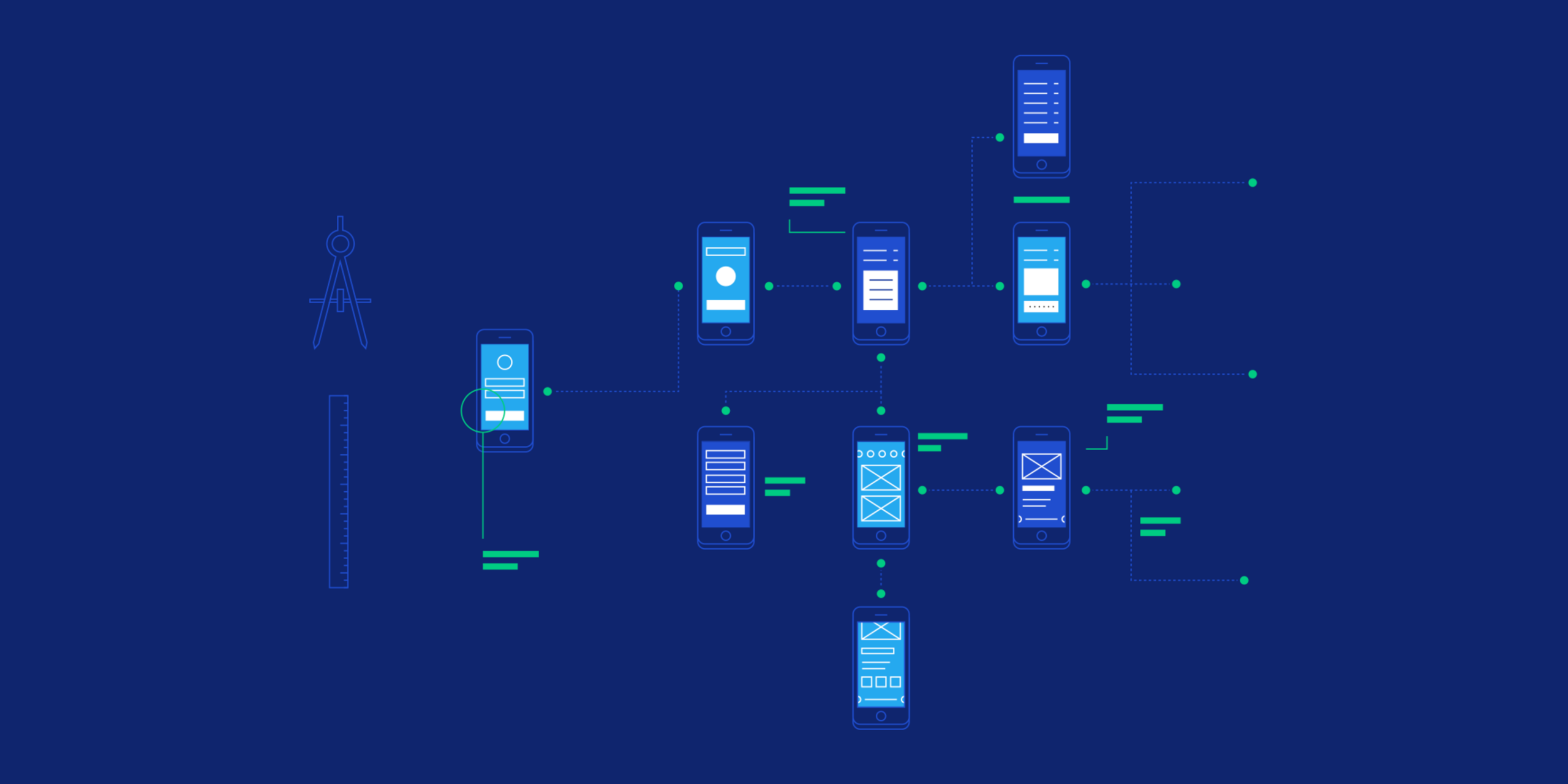

Plataformas de IA comienzan a interpretar señales sutiles —velocidad de scroll, ruta del cursor, microgestos para reorganizar la interfaz y reducir fricción.

La IA ya no solo reacciona a lo que el usuario hace: empieza a anticiparse. Herramientas modernas analizan patrones de navegación, tiempos de pausa, tendencias de movimiento, trayectorias de cursor y hasta microgestos en pantallas táctiles (presiones, aceleración del dedo, movimientos previos).

Con estos datos, la interfaz puede predecir qué hará el usuario a continuación: completar un formulario, buscar un botón, volver atrás, dudar entre dos opciones o abandonar un proceso. Basándose en esa predicción, la UI se reorganiza en tiempo real. Puede simplificar un menú, resaltar un botón, reducir pasos o mostrar una versión más clara de un flujo confuso.

Esto es particularmente útil en apps educativas, de salud y de comercio electrónico, donde la anticipación reduce errores y agiliza procesos críticos.

El desafío ético es enorme: ¿cuándo una interfaz ayuda y cuándo manipula? Las nuevas regulaciones exigen transparencia sobre qué decisiones toma la IA y por qué.

Aun así, todo indica que este será uno de los pilares del diseño digital en la próxima década.